Contact scientifique

Benjamin Morillon

Chercheur Inserm

Unité 1106 Institut de neurosciences des systèmes – INS Équipe « Dynamique des processus cognitifs »

+33 (0)4 91 38 55 77

Le cerveau humain ne mobilise pas ses hémisphères de façon équivalente lorsqu’il s’agit de reconnaître une mélodie ou de comprendre une phrase à l’oral. Si ce concept est reconnu des scientifiques, jusqu’à présent, le phénomène n’était pas expliqué au niveau physiologique et neuronal. Une équipe de recherche codirigée par le chercheur Inserm Benjamin Morillon à l’Institut de neurosciences des systèmes (Inserm/Aix-Marseille Université), en collaboration avec des chercheurs de l’Institut-Hôpital neurologique de Montréal de l’Université McGill, est parvenue à montrer que, grâce à des réceptivités différentes aux composantes du son, les neurones du cortex auditif gauche participeraient à la reconnaissance du langage, tandis que les neurones du cortex auditif droit participeraient à celle de la musique. Ces résultats à paraître dans Science suggèrent que la spécialisation de chaque hémisphère cérébral pour la musique ou le langage permettrait au système nerveux d’optimiser le traitement des signaux sonores à des fins de communication.

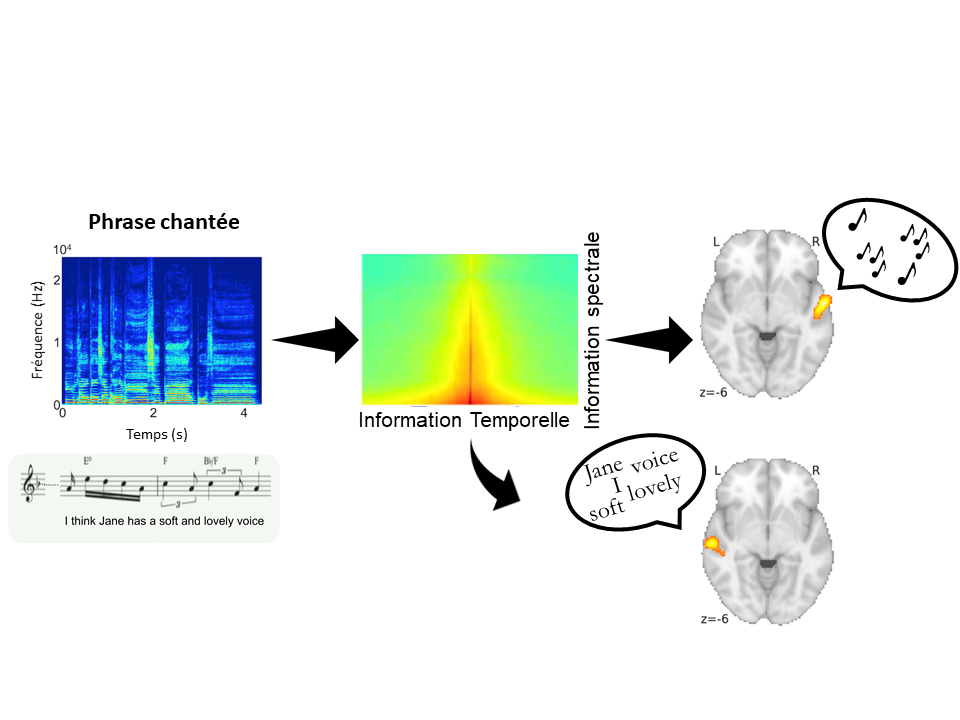

Le son est issu d’un ensemble complexe de vibrations de l’air qui, lorsqu’elles arrivent dans l’oreille interne au niveau de la cochlée, y sont discriminées en fonction de leur vitesse : à chaque instant, les vibrations lentes sont traduites en sons graves et les vibrations rapides en sons aigus. Cela permet de représenter le son selon deux dimensions : la dimension spectrale (fréquence) et la dimension temporelle (temps).

Ces deux dimensions auditives sont fondamentales car c’est leur combinaison en simultané qui stimule les neurones du cortex auditif. Ces derniers permettraient notamment de discriminer les sons pertinents pour l’individu, tels que les sons utilisés pour la communication qui permettent l’échange et la compréhension entre individus.

Une équipe de recherche codirigée par le chercheur Inserm Benjamin Morillon à l’Institut de neurosciences des systèmes (Inserm/Aix-Marseille Université), en collaboration avec des chercheurs de l’Institut-Hôpital neurologique de Montréal de l’Université McGill, a utilisé une approche innovante pour comprendre comment le langage et la musique sont décodés au sein de chaque hémisphère cérébral chez l’humain.

Les chercheurs ont enregistré 10 phrases chantées chacune par une soprane sur 10 airs mélodiques inédits composés pour l’occasion. Ces 100 enregistrements, dans lesquels mélodie et parole sont dissociées, ont ensuite été déformés en diminuant la quantité d’information présente dans chaque dimension du son. Il a été demandé à 49 participants d’écouter ces enregistrements déformés par paire, et de déterminer s’ils étaient identiques au niveau de la mélodie ou au niveau du texte. L’expérience a été menée en français et en anglais, afin d’observer si les résultats étaient reproductibles dans des langues différentes.

Une démonstration du test audio proposé aux participants est disponible (en anglais) sur le lien suivant :

https://www.zlab.mcgill.ca/spectro_temporal_modulations/

L’équipe de recherche a constaté que, quelle que soit la langue, lorsque l’information temporelle était déformée les participants étaient capables de reconnaître la mélodie, mais avaient des difficultés à identifier le contenu du texte. À l’inverse, lorsque l’information spectrale était déformée, ils étaient capables de reconnaître le texte mais avaient du mal à reconnaître la mélodie.

L’observation par imagerie par résonance fonctionnelle (IRMf) de l’activité neuronale des participants a montré que, dans le cortex auditif gauche, l’activité variait en fonction de la phrase présentée mais restait relativement stable d’une mélodie à l’autre, tandis que dans le cortex auditif droit, l’activité variait en fonction de la mélodie présentée mais restait relativement stable d’une phrase à l’autre.

De plus, lorsque l’information temporelle était dégradée, seule l’activité neuronale du cortex auditif gauche était affectée, tandis que la dégradation de l’information spectrale affectait uniquement l’activité du cortex auditif droit. Enfin, les performances des participants dans la tâche de reconnaissance pouvaient être prédites seulement en observant l’activité neuronale de ces deux aires.

Extrait original de chant a capella (en bas à gauche) et son spectrogramme (au-dessus, en bleu) décomposé en fonction de la quantité d’informations spectrales et temporelles (au centre). Les cortex auditifs droit et gauche du cerveau (côté droit de la figure) décodent respectivement la mélodie et la parole.

« Ces résultats indiquent que dans chaque hémisphère cérébral, l’activité neuronale est dépendante du type d’information sonore, précise Benjamin Morillon. Si l’information temporelle est secondaire pour reconnaître une mélodie, elle est au contraire primordiale à la bonne reconnaissance du langage. Inversement, si l’information spectrale est secondaire pour reconnaître le langage, elle est primordiale pour reconnaître une mélodie. »

Les neurones du cortex auditif gauche seraient ainsi principalement réceptifs au langage grâce à leur meilleure capacité à traiter l’information temporelle, tandis que ceux du cortex auditif droit seraient, eux, réceptifs à la musique grâce à leur meilleure capacité à traiter l’information spectrale. « La spécialisation hémisphérique pourrait être le moyen pour le système nerveux d’optimiser le traitement respectif des deux signaux sonores de communication que sont la parole et la musique », conclut Benjamin Morillon.

Benjamin Morillon

Chercheur Inserm

Unité 1106 Institut de neurosciences des systèmes – INS Équipe « Dynamique des processus cognitifs »

+33 (0)4 91 38 55 77

Distinct sensitivity to spectrotemporal modulation supports brain asymmetry for speech and melody Philippe Albouy1,2,3*, Lucas Benjamin1, Benjamin Morillon4!, and Robert J. Zatorre1,2† 1 Cognitive Neuroscience Unit, Montreal Neurological Institute, McGill 5 University, Montreal, Canada 2 International Laboratory for Brain, Music and Sound Research (BRAMS); Centre for Research in Brain, Language and Music; Centre for Interdisciplinary Research in Music, Media, and Technology, Montreal, Canada 3 CERVO Brain Research Centre, School of Psychology, Laval University, Quebec, Canada 4 Aix Marseille Univ, Inserm, INS, Inst Neurosci Syst, Marseille, France *Corresponding author † Equal contributions Science: https://science.sciencemap.orp/cpi/doi/10.1126/science.aaz3468