Une nouvelle technique d’imagerie par ultrasons a permis de visualiser pour la première fois, in vivo chez le rat, l’activité dans le cortex piriforme lors de la perception d’une odeur. Cette structure cérébrale profonde joue un rôle important dans l’olfaction et restait jusqu’à présent inaccessible par imagerie fonctionnelle. Ces travaux apportent également de nouvelles données sur le fonctionnement, encore mal connu, du système olfactif, notamment sur la façon dont sont traitées les informations au niveau cérébral.

Cette étude est le résultat d’une collaboration entre l’équipe de Mickaël Tanter de l’Institut Langevin (CNRS/Inserm/ESPCI ParisTech/UPMC/Université Paris Diderot) et celle de Hirac Gurden du laboratoire Imagerie et modélisation en neurobiologie et cancérologie (CNRS/Université Paris-Sud/Université Paris Diderot). Elle est publiée dans la revue NeuroImage du 15 juillet 2014.

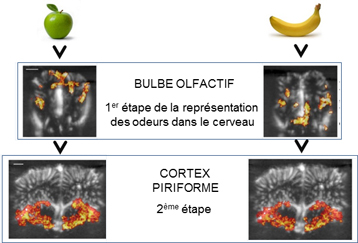

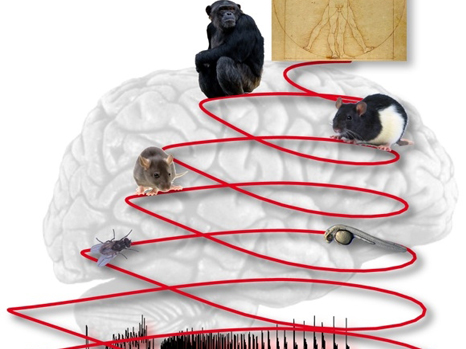

Comment aboutir à une représentation de l’environnement extérieur à partir de la perception des sens ? Comment, par exemple, les informations olfactives liées à la nourriture ou aux parfums sont-elles traitées par le cerveau ? Si l’organisation du système olfactif est bien connue – elle est semblable des insectes jusqu’aux mammifères – son fonctionnement est encore peu compris. Pour répondre à ces questions, les chercheurs se sont donc intéressés à deux structures cérébrales qui constituent des relais majeurs pour l’olfaction : le bulbe olfactif et le cortex piriforme. Chez le rat, le bulbe olfactif se situe entre les deux yeux, juste derrière l’os du nez. Le cortex piriforme est par contre une structure beaucoup plus profonde du cerveau des rongeurs dont aucune image fonctionnelle n’avait pu être enregistrée chez un animal vivant jusqu’à présent.

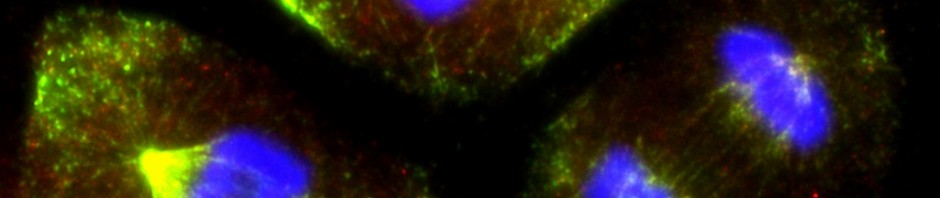

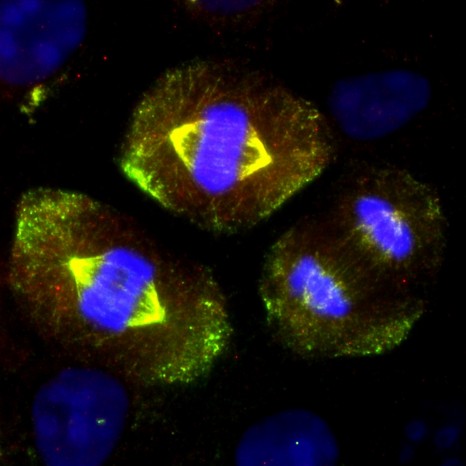

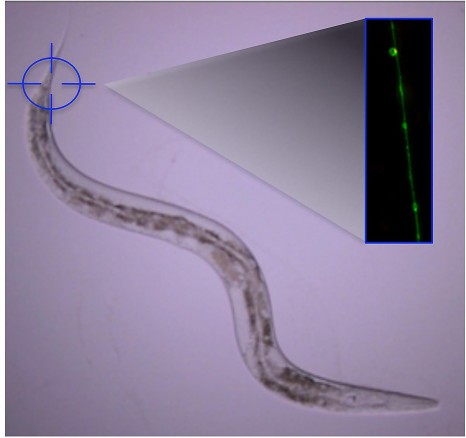

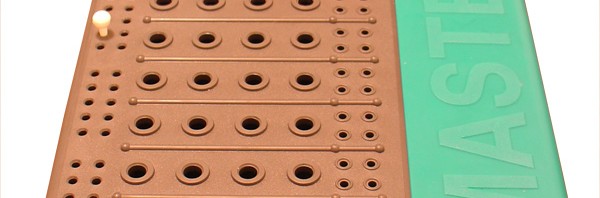

La technique d’imagerie neurofonctionnelle par ultrasons développée par l’équipe de Mickaël Tanter, baptisée fUS (functional Ultrasound), a permis de suivre l’activité neuronale du cortex piriforme. Elle est basée sur l’envoi d’ondes planes ultrasonores dans les tissus cérébraux. Les échos renvoyés par les structures traversées par ces ondes permettent, après traitement des données, d’obtenir des images ayant une résolution spatiotemporelle inégalée : 80 micromètres et quelques dizaines de millisecondes.

Le contraste obtenu sur ces images est lié aux variations du flux sanguin dans le cerveau. En effet, l’activité des cellules nerveuses nécessite un apport en énergie : elle est donc couplée à un afflux de sang dans la zone concernée. En enregistrant les variations de volume dans les vaisseaux sanguins qui alimentent les différentes structures cérébrales, il est ainsi possible de connaître la localisation des neurones activés.

Plusieurs techniques d’imagerie, comme l’IRM, s’appuient déjà sur le lien entre volume sanguin et activité neuronale. Mais fUS est avantageuse en terme de coût, de maniabilité et de résolution. De plus, elle donne un accès facilité aux structures les plus profondes, situées plusieurs centimètres sous la boîte crânienne.

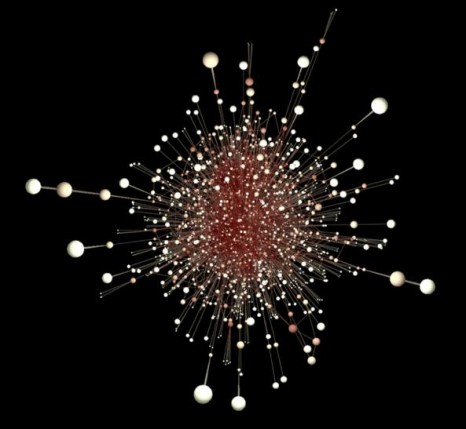

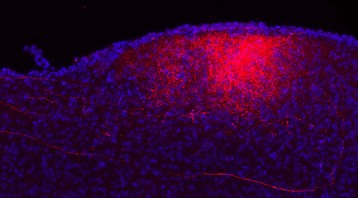

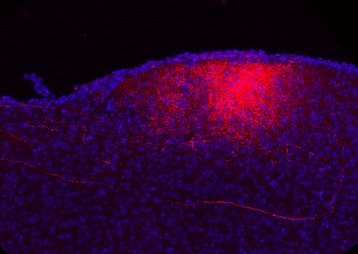

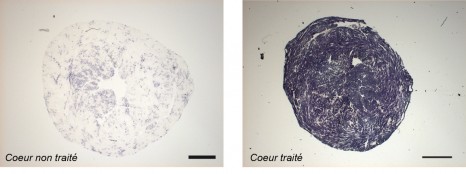

Les enregistrements effectués par cette technique dans l’équipe de Hirac Gurden ont permis d’observer la répartition spatiale de l’activité dans le bulbe olfactif. Lorsqu’une odeur est perçue, on observe une augmentation du volume sanguin dans des zones bien définies : à chaque odeur correspond une carte spécifique de neurones sollicités. Au-delà de ce résultat, les images révèlent aussi, pour la première fois, l’absence de cette répartition spatiale dans le cortex piriforme. A ce niveau, deux odeurs différentes entraînent la même activation de l’ensemble de la zone.

Les mécanismes cellulaires responsables de la disparition de la signature spatiale ne sont pas encore bien définis mais ce résultat permet déjà de formuler plusieurs hypothèses. Le cortex piriforme pourrait être une structure qui ne sert pas seulement à traiter les stimuli olfactifs mais plutôt à intégrer plusieurs types d’informations et à les mémoriser. Se détacher des cartographies strictes associées à chaque odeur permettrait de faire des associations et d’aboutir à un concept global. Par exemple, à partir de la perception de centaines de molécules odorantes contenues dans le café, le cortex piriforme permettrait de reconnaître une unique odeur : celle du café.

Ces travaux ouvrent de nouvelles perspectives pour l’imagerie et pour la neurobiologie. Les chercheurs vont maintenant s’intéresser à l’effet de l’apprentissage sur l’activité du cortex afin de mieux comprendre son rôle et les spécificités du système olfactif.

Sur ces images, l’activation cérébrale détectée par imagerie ultrasonore est visualisée en rouge. A la présentation d’une odeur donnée, des territoires spécifiques sont sollicités dans le bulbe olfactif mais pas dans le cortex piriforme. © Michaël Tanter / Hirac Gurden